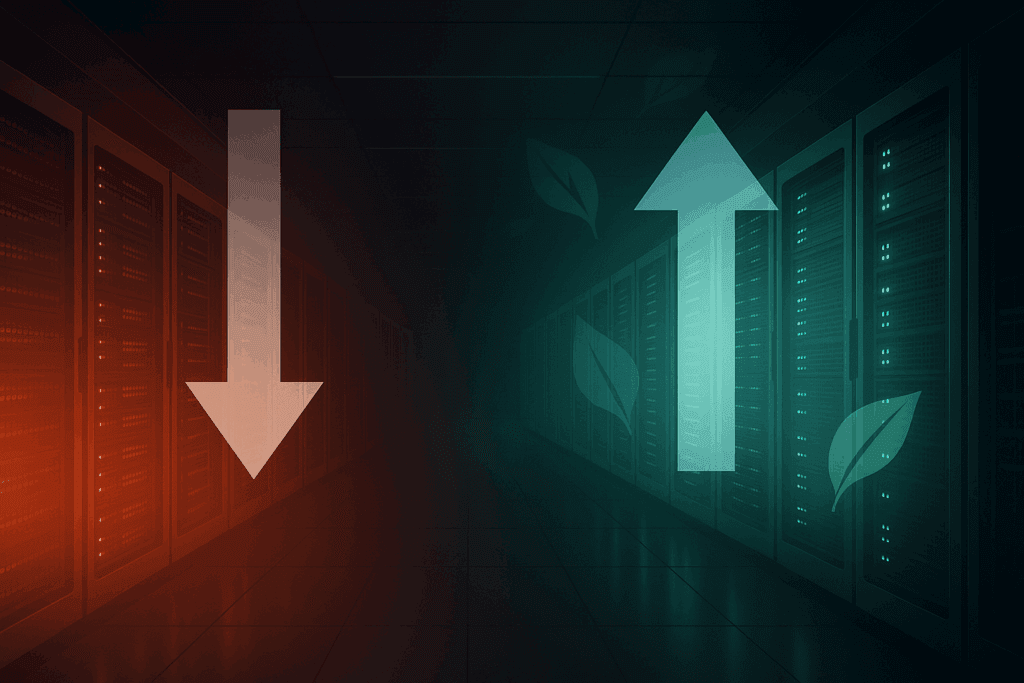

生成AIは、人間のように文章を作るために膨大な計算を行う。この計算を支えるために、マイクロソフトやグーグルは何十万枚ものGPUをデータセンターに並べているが、その規模だけ電力と設備コストが跳ね上がるという問題を抱えている。そこで韓国科学技術院(KAIST)の朴鐘世教授の研究グループは、米ハイパーアクセル社と協力して、新しい専用チップ――NPU(ニューラルプロセッシングユニット)を開発した。このNPUは「量子化」と呼ばれる工夫でデータを小さくまとめ、メモリを圧迫するKVキャッシュを効率よく扱えるようにした。その結果、ChatGPT-4やGemini 2.5といった巨大モデルでも計算速度を平均で60%以上高めつつ、消費電力を約44%削減できる。つまり、今まで多数のGPUが必要だった仕事を、はるかに少ないNPUでこなせるようになり、クラウド運営のコストと環境負荷の双方を軽減できるわけだ。この成果は2025年6月に東京で開かれた国際会議ISCAで発表され、AIインフラの常識を塗り替える転換点として高い注目を集めている。

開発の背景と課題

生成AIが文章や画像を生み出す際、モデル内部では単語や記号を細かく刻んだ「トークン」が常に何千、何万単位で行き交う。この膨大なデータを一瞬も止めずに読み書きするには、広いパイプのようなメモリ帯域と、巨大な倉庫に相当するメモリ容量の両方が不可欠となる。現在主流のGPUは超高速HBMメモリを何層も重ねて帯域と容量を確保するが、サーバーラックにカードを足すたびに電力消費が跳ね上がり、熱を逃がす冷却設備も大がかりになってコストが爆発的に増える。朴鐘世教授らの研究チームは、この「メモリがボトルネック」という根本課題を解決しなければ次世代の生成AIは頭打ちになると判断し、まずモデル内部で最も容量を食うKVキャッシュを小さく圧縮する量子化アルゴリズムを考案した。そして、その圧縮データを無駄なくさばける専用NPUアーキテクチャの設計に着手し、少ないチップ数でも高性能を引き出す道筋を示した。

量子化アルゴリズムの革新性

従来の量子化では、重みやアクティベーションの値を一律に8ビットへ丸めるため、細かな数値差がつぶれてモデルの応答が鈍るという欠点があった。今回の手法はまず各レイヤーで値の分布を統計的に分析し、ばらつきの大きさに応じて量子化範囲を動的に調整することで、必要な解像度だけを残しつつ無駄なビットを削ぎ落とす。さらに圧縮後のデータをメモリのページ単位で再配置し、読み込み時に連続アクセスが生じるよう最適化した結果、帯域を詰まらせる要因が取り除かれた。これら二段構えの工夫により、従来法で目立った精度低下をほぼ抑えながら、メモリ使用量と転送量を同時に削減することに成功している。

ハードウェア設計のポイント

新しいNPUコアは、本体となる演算エンジンの仕組みそのものをいじらずに、メモリとデータをやり取りする通り道――メモリインターフェースだけを太くした点が特徴だ。ここに量子化されたデータを高速に詰め込み直す専用エンコーダと、圧縮後のKVキャッシュを効率よく出し入れする管理回路を盛り込み、同じシリコン面積でも実際に扱えるデータ量を大幅に増やした。例えるなら、倉庫自体の広さは変えずに通路を増やし、荷物の梱包を小さく整え、フォークリフトの動線を最適化したようなものだ。その結果、一つのラックに並べるNPUの枚数を従来のGPU構成より約三割減らしても、合計の計算能力と処理速度はむしろ上回るレベルまで押し上げられた。システム全体の電力と設置コストを抑えつつ、演算リソースを無駄なく使い切るインフラが実現したわけである。

実証結果とインパクト

実証試験では、ChatGPT-4に相当する巨大モデルを新しいNPUクラスタ上で動かし、従来のGPU構成と詳細に比較した。その結果、ユーザーが応答を待つ時間に直結する推論レイテンシが平均で62%短縮され、同じ電力1ワットあたりに生み出せる計算量は1.8倍に伸びた。言い換えれば、より少ないエネルギーでより多くの答えを返せる仕組みが整ったということだ。年間ベースで換算するとデータセンター全体の電力使用量を44%削減でき、電気料金だけでなく冷却や送電に伴うCO₂排出も大幅に抑えられる。高性能化と環境負荷低減を同時に達成できる点が、クラウド事業者にとって極めて大きいインパクトとなる。

筆者解説

ポイント整理

新型NPUは、メモリ階層を細かく最適化したうえで量子化を組み合わせ、演算パイプラインが空転する時間をほぼゼロにしたことで処理を加速している。加えて、演算回数とメモリアクセスそのものを減らした結果、チップ内部の電圧と周波数を必要に応じて下げる動的制御が可能となり、電力の浪費を大幅に削った。さらに、NPUをモジュール単位で増減できる設計としたため、既存のGPUクラスタに柔軟に混在させながらシステムを段階的に拡張できるという拡張性も備えている。

さらに解説

これまでのAIクラウドは「CPUで前処理を行い、GPUで大量計算をこなす」という二層構造が主流だったが、生成AIが要求する演算量とメモリ量はその枠を超えつつある。NPUは行列演算に特化した回路を持ち、同等の演算をより低いクロックで実行できるため、発熱と消費電力を抑えながら性能を伸ばせる。しかも量子化によりデータ一つ当たりのサイズが小さくなるため、メモリ容量だけでなくサーバー間をつなぐネットワークを流れる情報量も減り、スイッチやケーブルといった周辺機器の数も縮小可能になる。

キーワード解説

- AIクラウドインフラ

生成AIや機械学習を支えるデータセンター全体の基盤。GPUやNPUといった加速器、超高速ネットワーク、冷却設備を一体で設計し、大規模モデルを即座に拡張できる仕組みである。 - NPU(ニューラルプロセッシングユニット)

行列演算専用に最適化されたプロセッサ。GPUより電力当たりの処理量が高く、深層学習の推論や訓練を省エネで加速できる点が強みとなる。 - 生成AI

テキスト・画像・音声など新しいコンテンツをゼロから作り出すAI技術の総称。大規模言語モデルや拡散モデルが代表例で、チャットボットや画像生成サービスに活用される。 - 量子化(Quantization)

モデルの重みや中間データを4〜8ビット程度に丸めて記録し、メモリと通信負荷を大幅に削減する手法。統計的補正を併用することで精度低下を最小限に抑えられる。 - KVキャッシュ

トランスフォーマーモデルが過去トークンのキーとバリューを保存しておく倉庫のような領域。ここを圧縮すると再計算が減り、応答速度向上に直結する。 - メモリ帯域

プロセッサとメモリの間で1秒間に転送できるデータ量。帯域が不足すると演算器がデータ待ちで遊休し、装置全体の性能が頭打ちになる。

まとめ &

NPUを軸にした新世代のAIクラウドは、GPU不足と高騰する電力費という二重苦を同時に解きほぐす鍵となる。量子化で削ったメモリと専用ハードの相乗効果により、生成AIはこれまで以上に高速かつ低コストへ進化する。インフラ刷新を検討する企業は、今こそ最新NPUソリューションの実地検証を進めるべきである。